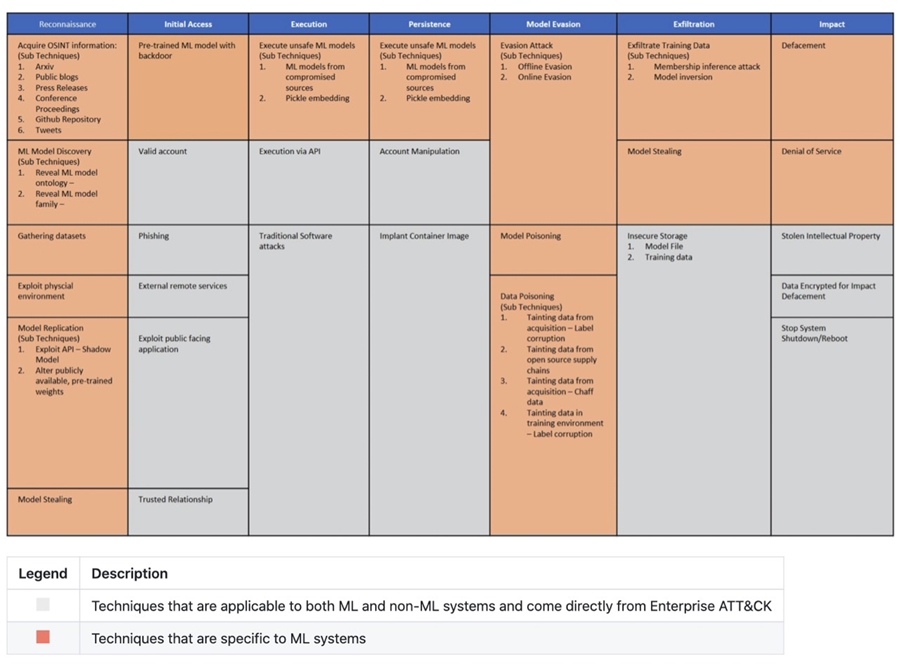

Ma trận các mối đe dọa chỉ ra các tấn công hệ thống học máy

Một báo cáo của Hiệp hội SHERPA (một dự án của châu Âu nghiên cứu tác động của trí tuệ nhân tạo (AI) đối với đạo đức và nhân quyền) được công bố vào năm 2019 đã lưu ý rằng, hầu hết các cuộc tấn công vào hệ thống AI đều tập trung vào việc thao túng chúng (ví dụ: tác động đến hệ thống khuyến nghị để ưu tiên hiển thị những nội dung cụ thể), tuy nhiên các cuộc tấn công mới vào hệ thống học máy (ML) nằm trong khả năng của kẻ tấn công.

Microsoft cho biết, hiện nay các cuộc tấn công vào hệ thống ML đang gia tăng. Tổ chức nghiên cứu bảo mật MITRE (Mỹ) lưu ý trong ba năm qua, hệ thống ML của các công ty lớn như Google, Amazon, Microsoft và Tesla đã bị đánh lừa hoặc vượt qua. Trong khi đó, hầu hết các doanh nghiệp chưa có các công cụ phù hợp để bảo mật hệ thống ML và vẫn đang tìm kiếm giải pháp.

Do đó, các chuyên gia tại Microsoft, MITRE, IBM, NVIDIA, Đại học Toronto, Viện ML Berryville, cũng như một số công ty và tổ chức giáo dục khác đã quyết định tạo ra phiên bản đầu tiên của “Ma trận các mối đe dọa tấn công hệ thống ML”, để giúp các nhà phân tích bảo mật phát hiện và ứng phó với các mối đe dọa mới này.

ML là một lĩnh vực con của AI. Nó dựa trên các thuật toán máy tính để đưa dữ liệu huấn luyện vào và “học” từ nó, sau đó sẽ đưa ra các dự đoán, quyết định hoặc phân loại chính xác dữ liệu. Các thuật toán học máy được sử dụng cho các nhiệm vụ như phát hiện thư rác, phát hiện các mối đe dọa mới, dự đoán sở thích người dùng, thực hiện chẩn đoán y tế,...

Bảo mật cần được tích hợp sẵn vào hệ thống ML

Mikel Rodriguez, nhà nghiên cứu ML tại MITRE, người giám sát các chương trình nghiên cứu khoa học của MITRE, cho biết: “Giai đoạn hiện tại của chúng ta với AI giống như đối với Internet cuối những năm 80, khi mọi người chỉ cố gắng sử dụng Internet mà không nghĩ đến bảo mật”.

Tuy nhiên, chúng ta có thể rút ra bài học từ sai lầm đó, và đó là một trong những lý do khiến “Ma trận các mối đe dọa tấn công hệ thống ML” được tạo ra. Ông lưu ý: “Với ma trận các mối đe dọa này, các nhà phân tích bảo mật có thể làm việc với các mô hình mối đe dọa đối với hệ thống ML dựa trên các sự cố thực tế, mô phỏng hành vi của đối thủ”.

Ngoài ra, ma trận sẽ giúp họ tư duy tổng thể, thúc đẩy giao tiếp và hợp tác tốt hơn giữa các tổ chức bằng cách đưa ra một ngôn ngữ chung hoặc phân loại các lỗ hổng.

Ma trận các mối đe dọa tấn công hệ thống ML

“Không giống như các lỗ hổng bảo mật mạng truyền thống liên quan đến các hệ thống phần mềm và phần cứng cụ thể, các lỗ hổng trong hệ thống ML được kích hoạt bởi các hạn chế được kế thừa trong các thuật toán ML. Dữ liệu có thể được vũ khí hóa theo những cách mới, đòi hỏi phải mở rộng cách thức lập mô hình hành vi tấn công mạng, để phản ánh các các hướng tấn công mới nổi và vòng đời của các tấn công hệ thống ML đang liên tục phát triển nhanh chóng”, MITRE lưu ý.

Ma trận này đã được mô hình hóa trên nền tảng MITRE ATT&CK như sau:

Nhóm nghiên cứu đã biểu diễn các cách thức mà cuộc tấn công trước đó cho dù là từ các nhà nghiên cứu hay cộng đồng mạng, có thể được ánh xạ vào ma trận như thế nào.

Họ cũng nhấn mạnh rằng sẽ cập nhật thường xuyên khi nhận được phản hồi từ cộng đồng ML và bảo mật. Họ khuyến khích những người đóng góp chỉ ra các kỹ thuật mới, đề xuất các biện pháp (phòng thủ) tốt nhất và chia sẻ các ví dụ về các cuộc tấn công thành công vào hệ thống ML.

“Chúng tôi đặc biệt hào hứng với các nghiên cứu mới! Chúng tôi mong đợi sự đóng góp từ cả các nhà nghiên cứu trong ngành công nghiệp và học thuật”, MITRE kết luận.

Võ Nhân